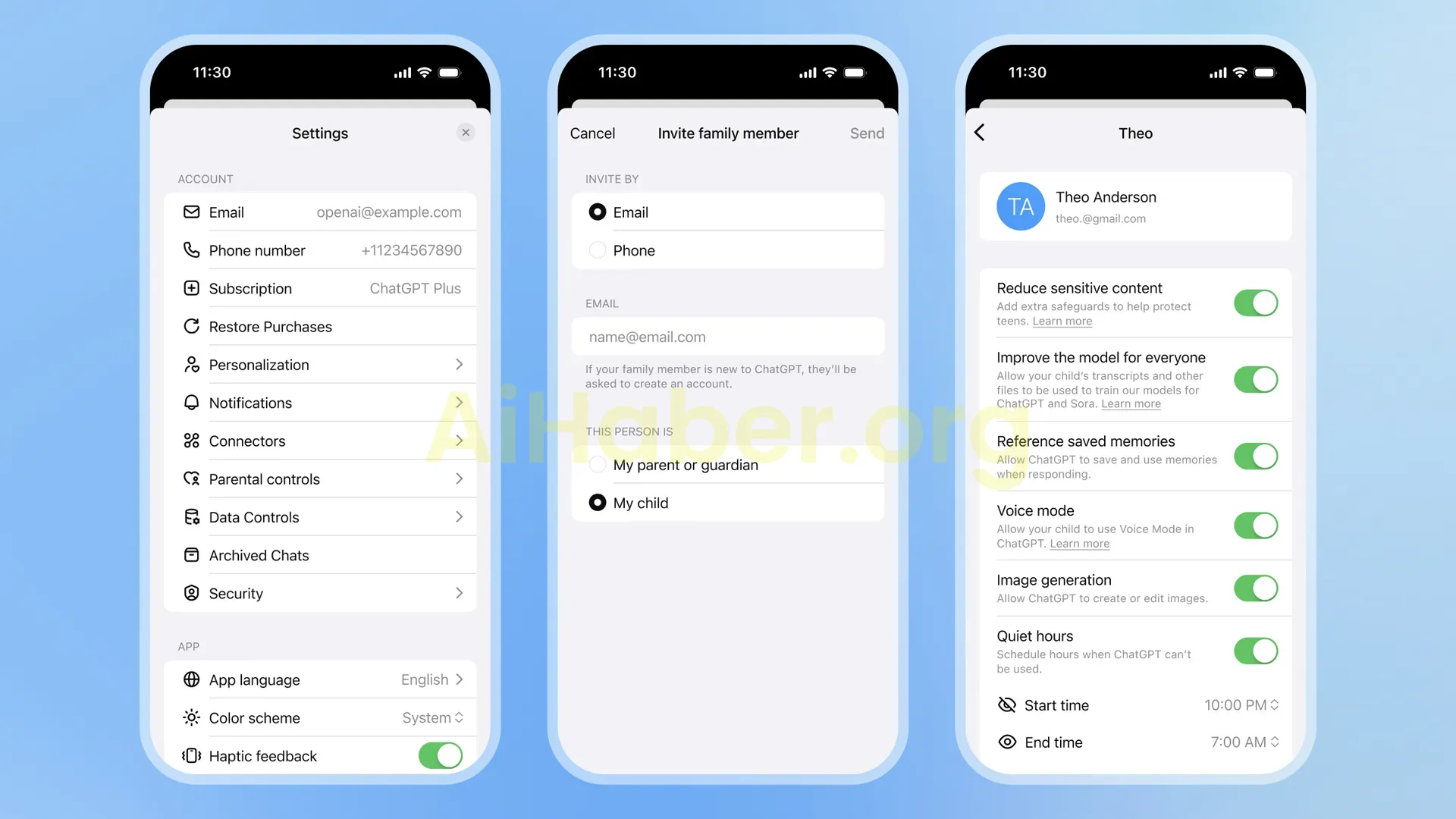

ChatGPT, gençlerin güvenli bir şekilde kullanabilmesi için Chatgpt ebeveyn modu denetimlerini başlattı OpenAI, kısa süre...

OpenAI Safeguard: Stunning Şeffaflık ile En İyi Güvenlik

OpenAI’den Yeni Hamle: Safeguard Modellerinde Şeffaflık Dönemi Başladı

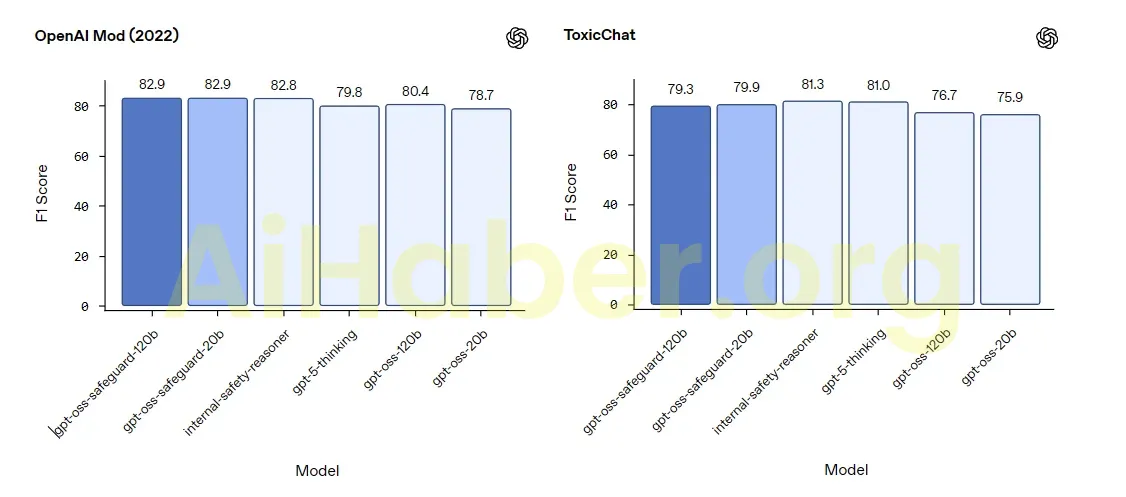

Safeguard modelleri, OpenAI’nin son dönemde yapay zekâ alanında başlattığı şeffaflık hareketinin en önemli göstergelerinden biri olarak öne çıkıyor. Açık kaynak dünyasına sunulan gpt-oss-safeguard-120B ve gpt-oss-safeguard-20B modelleri, yapay zekâ sistemlerinin nasıl daha güvenli ve denetlenebilir hâle getirilebileceğinin yeni yollarını tanımlıyor. OpenAI, sadece teknolojik ilerleme değil, etik ve güvenlik konularında da lider bir yaklaşım benimsiyor.

Safeguard Modelleri Nedir ve Ne Sunuyor?

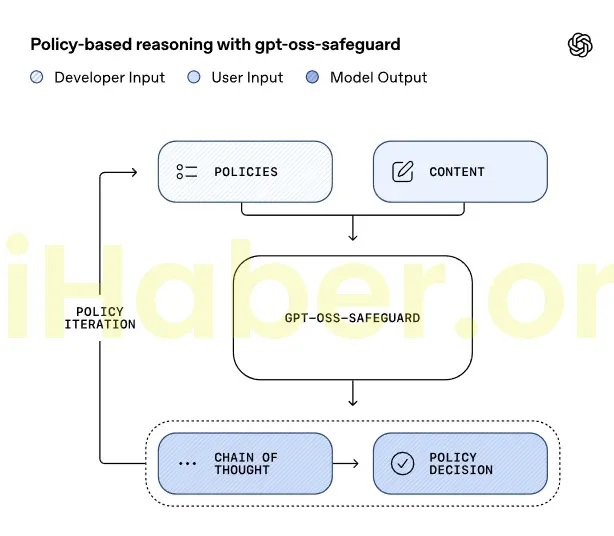

OpenAI tarafından geliştirilen Safeguard modelleri, yapay zekâ çıktılarında güvenlik politikasını gerçek zamanlı olarak denetleme yeteneğine sahip. Yani, bir yapay zekâ modeli yanıt üretirken, modelin hangi güvenlik kurallarına göre hareket ettiğini adım adım izleyebiliyorsunuz. Bu süreç, geleneksel filtreleme yöntemlerinden farklı olarak daha dinamik ve geliştiriciye özel esneklik sunuyor.

“Safeguard” özelliği sayesinde modeller, yalnızca zararlı ya da riskli içeriklerin tespitini yapmakla kalmıyor – aynı zamanda o sınıflandırmayı neden ve nasıl yaptığına ilişkin bir düşünce zinciri sunuyor. Böylece sistemin aldığı kararlar kullanıcıya ve geliştiriciye şeffaf şekilde aktarılabiliyor. Özellikle açık kaynak dünyasında, modellerin karar alma süreçlerinin izlenebilir ve anlaşılabilir olması kritik bir avantaj sağlıyor.

Güvenlik ve Denetlenebilirlikte Yeni Standart: Safeguard Modellerinin Detayları

Safeguard modellerini rakiplerinden ayıran en önemli özelliklerden biri, geliştiricilerin kendi güvenlik kurallarını çalışma anında tanımlayabilmeleri. Yani, modelin davranışlarını ya da filtrelerini sabit kodlarla önceden belirlemek yerine, kullanıcının belirlediği kriterlere göre dinamik olarak yorumlama yapılabiliyor.

Bu yöntem, iki önemli fayda getiriyor:

- Sistem, farklı uygulama alanları ve kullanıcı ihtiyaçlarına göre esnekçe uyarlanabiliyor.

- Her bir karar süreci, açıklanabilir ve şeffaf hâle getiriliyor. Yani bir model, bir içerik üzerinde filtre uyguladığında, “Bu kararı neden verdim?” sorusuna ayrıntılı bir yanıt sunabiliyor.

Ayrıca Safeguard modelleri, “düşünce zinciri” denen açıklama mekanizması ile, alınan kararların ardındaki mantığı adım adım gösteriyor. Yapay zekâ sistemlerinde şeffaflığın artması, hem son kullanıcı hem de geliştirici açısından güven oluşturuyor.

Apache 2.0 ile Açık Kaynak ve Ticari Esneklik

OpenAI, Safeguard modellerini Apache 2.0 lisansı altında yayımlayarak önemli bir yenilik sundu. Bu lisans sayesinde modeller yalnızca akademik ya da topluluk bazlı uygulamalarda değil, ticari projelerde de kullanılabiliyor ve özelleştirilebiliyor. Yani şirketler kendi güvenlik politikalarını tanımlayarak, bu yeni modelleri kendi ürünlerine veya sistemlerine entegre edebiliyor.

Bu hareket, açık kaynak ekosisteminde güvenlik ve etik standartların yükseltilmesine önemli bir katkı sağladı. Herkesin ulaşabileceği, ücretsiz ve özelleştirilebilir bu modeller sayesinde, yapay zekâ uygulamalarında daha sorumlu bir gelişim süreci başlamış oldu.

Safeguard Modelleri ile Yapay Zekâda Şeffaflık Çağı

Yapay zekâ alanında güvenlik, son yılların en çok tartışılan konularından biri. Safeguard modelleri ile beraber OpenAI, güvenlik politikalarının anlık denetimi ve karar mekanizmalarının adım adım açıklanabilmesi sayesinde, sektöre yeni bir şeffaflık ve denetlenebilirlik standardı kazandırıyor.

Artık geliştiriciler, bir yapay zekâ modelinin neden belli kararları verdiğini rahatça görebilecek ve bu süreçleri kendi ihtiyaçlarına göre uyarlayabilecek. Bu da hem son kullanıcılar hem de iş dünyası için yapay zekâ uygulamalarını daha öngörülebilir ve güvenli hâle getirecek.

Sonuç

Safeguard modelleriyle OpenAI, yapay zekâda şeffaflık çağını başlatıyor. gpt-oss-safeguard-120B ve gpt-oss-safeguard-20B ile güvenlik mekaniğini geliştiriciye ve kullanıcıya açan bu yaklaşım, sektörde yeni bir dönemin kapılarını aralıyor. Modellerin açık kaynak olarak yayımlanması, hem topluluk hem de endüstri standartlarının yükselmesine katkı sağlıyor. OpenAI’nin bu yeniliği, geleceğin daha güvenli, sorumlu ve denetlenebilir yapay zekâ sistemleri için önemli bir adım.