Cursor 2.0 yayınlandı ve yazılım geliştirme dünyasında yeni bir çağın kapılarını araladı. Şirketin kendi...

Yapay zeka gerçek zamanlı sesli deepfake teknolojisi çığır açıyor, dolandırıcılık başarı oranı %100’e yaklaşıyor

Ses değiştirici kullanan arkadaşların, mevcut ana akım ses işleme çözümlerinin hepsinin belirli bir gecikme süresine sahip olduğunu az çok duymuş olması gerektiğini belirtti. Hatta etki ne kadar gerçekçiyse gecikmenin de o kadar yüksek olduğu söylenebilir.

Siber güvenlik şirketi NCC Group’un son açıklamasına göre, yapay zeka, sesli deep fake teknolojisini “gerçek zamanlı” aşamaya taşıyor ve saldırganların görüşmeler sırasında diğer kişilerin seslerini anında taklit edebilmesini sağlıyor; dolandırıcılık başarı oranı ise neredeyse %100.

Gerçek zamanlı ses sahteciliği teknolojisinde çığır açan gelişme

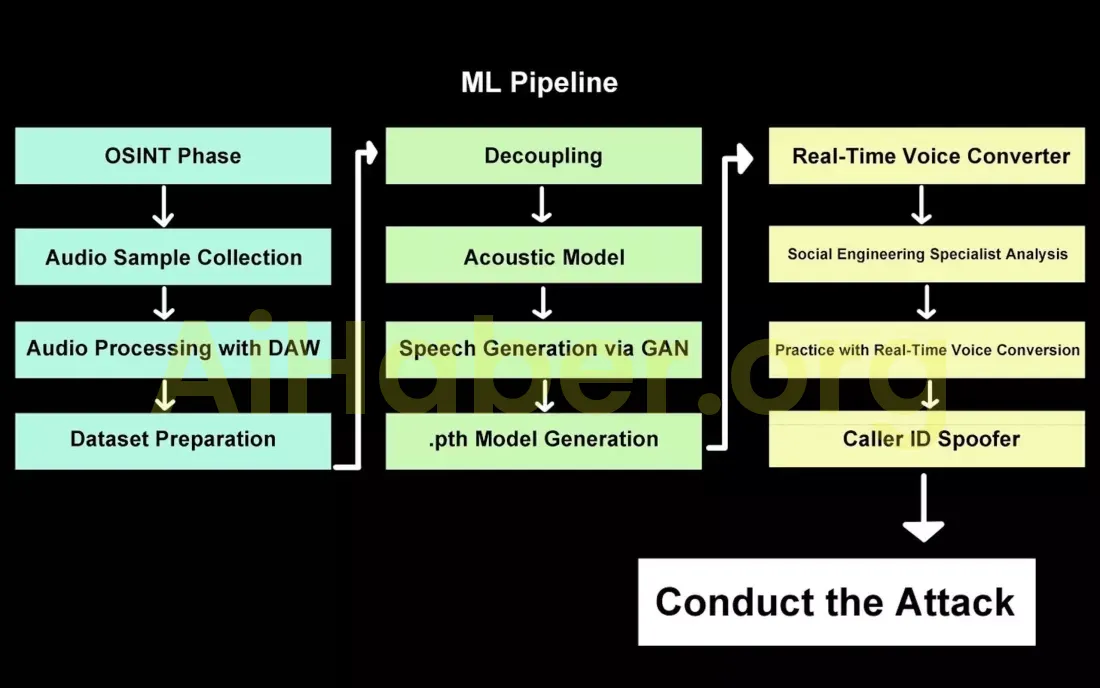

“Deepfake vishing” adı verilen bu teknoloji, hedef kişinin ses örneklerini öğrenmek için bir yapay zeka modeli kullanır. Operatör, özelleştirilmiş bir web arayüzü üzerinden tek bir tıklamayla bu teknolojiyi etkinleştirerek gerçek zamanlı ses “çevirisi” elde edebilir.

Araştırmacılar, sistemlerinin çalışması için yalnızca orta düzeyde bir işlem gücüne ihtiyaç duyduğunu belirtiyor. Nvidia RTX A1000 ekran kartına sahip bir dizüstü bilgisayarda, önceki takılma ve doğal olmayan his olmadan 0,5 saniyeden daha kısa bir gecikme süresi elde ettiler.

Testler, sistemin düşük kaliteli kayıtlarla bile son derece ikna edici ses kopyaları üretebildiğini göstermiştir. Dakikalarca eğitim gerektiren ve yalnızca önceden kaydedilmiş ses üretebilen eski ses taklit araçlarının aksine, bu sistem bir görüşme sırasında konuşmanın tonunu ve hızını gerçek zamanlı olarak kişinin isteklerine göre ayarlayabilir. Bu, sıradan insanların bile dizüstü bilgisayar veya akıllı telefon kullanarak benzer efektler elde edebileceği ve kötü amaçlı sömürüye karşı bariyeri daha da düşüreceği anlamına gelir.

Test sonuçları aldatma oranının son derece yüksek olduğunu gösteriyor

NCC Group’ta güvenlik danışmanı olan Pablo Alobera, yetkili ve kontrollü testlerde, gerçek zamanlı ses sahteciliği teknolojisinin arayan kimliği sahteciliğiyle birleştirildiğinde, neredeyse her deneyde denekleri başarıyla aldattığını belirtti . Alobera, bu teknolojik atılımın ses sahteciliğinin hızını ve güvenilirliğini önemli ölçüde artırdığını ve sıradan telefon görüşmelerinin bile dolandırıcılık amaçlı kullanılmasını mümkün kıldığını belirtti .

Video sahteciliği henüz yaygınlaşmadı

Ses sahteciliği teknolojisi gerçek zamanlı aşamaya ulaşmış olsa da, gerçek zamanlı video deepfake’leri henüz aynı seviyeye ulaşamadı. Son zamanlardaki yüksek kaliteli örnekler, insanları gerçekçi video sahnelerine “taşımak” için Alibaba WAN 2.2 Animate ve Google’ın Gemini Flash 2.5 Image gibi en son yapay zeka modellerine güveniyor .

Ancak bu sistemler, gerçek zamanlı video üretiminde tutarsız yüz ifadeleri, uyumsuz duygular ve ses senkronizasyonunun bozulması gibi sorunlarla karşı karşıya kalmaya devam ediyor. Yapay zeka güvenlik şirketi The Circuit’in kurucusu Trevor Wiseman, IEEE Spectrum’a verdiği demeçte, sıradan izleyicilerin bile “ton ve yüz ifadelerindeki tutarsızlıklar” aracılığıyla sahtecilik belirtilerini tespit edebileceğini söyledi.

Uzmanlar yeni kimlik doğrulama mekanizmaları çağrısında bulunuyor

Wiseman, yapay zeka destekli sahteciliklerin yaygın kullanımının şimdiden ciddi kayıplara yol açtığını belirtti. Örneğin, işe alım sürecinde deepfake bir videoyla kandırılan ve yanlışlıkla sahte bir adrese dizüstü bilgisayar gönderen bir şirketten bahsetti. Bu tür olaylar, sesli veya görüntülü aramaların artık güvenilir bir kimlik doğrulama yöntemi olmadığını gösteriyor .

Yapay zeka destekli kimliğe bürünme giderek yaygınlaştıkça, uzmanlar yeni kimlik doğrulama mekanizmalarının gerekli olduğu konusunda uyarıyor. Wiseman, uzaktan iletişim sırasında kimliği doğrulamak için beyzboldaki “gizli kodlar” kavramının benzersiz ve yapılandırılmış sinyaller veya kodlar kullanımına dahil edilmesini öneriyor . Bu tür önlemler alınmadığı takdirde, bireylerin ve kuruluşların giderek daha karmaşık hale gelen yapay zeka destekli sosyal mühendislik saldırılarına karşı risk altında olacağını vurguluyor.

Reklam Beyanı: Makalede yer alan harici bağlantılar (hiperlinkler, QR kodları, parolalar vb. dahil ancak bunlarla sınırlı olmamak üzere), daha fazla bilgi iletmek ve seçim süresini kısaltmak için kullanılmıştır. Sonuçlar yalnızca referans amaçlıdır.